Утечка алгоримтов ранжирования Google 2024 — попасть в ТОП может каждый

24 мая в публичный доступ попала часть алгоритмов ранжирования Google. Это подарок для любого, кто хочет получать трафик из Google для своих проектов будь то предприниматели, маркетологи или арбитражники

Данный материал есть в видео-формате на нашем YouTube-канале для тех кому больше по душе смотреть видео, а не читать тексты 😉

Меня зовут Олег Шестаков — я предприниматель, основатель SEO-агентства Rush Agency и уже более 12 лет занимаюсь исследованием алгоритмов поисковых систем так что у меня большой опыт в исследовании таких утечек от поисковых систем.

Я изучил уже вышедшие разборы от западных аналитиков и сам провел более 6 часов за разбором данного документа.

Что собственно за документ и на сколько ему можно верить?

Это документация к API одной из систем ранжирования Google, в которой описано боле 14.000 различных факторов ранжирования. Описания некоторым факторам напрямую говорят о том, что они значат. Другие же факторы невозможно как-то интерпретировать не будучи сотрудником отдела поиска Google.

Важно понимать, что в документации явно не указано, что какой-то фактор работает «вот так» и «оказывает влияние N на позицию сайта в поиске». Это я к тому, что интерпретировать данные из документа нужно очень аккуратно.

Не смотря на это — в документе много КОНКРЕТНОЙ информации, которую можно ПРИМЕНИТЬ НА ПРАКТИКЕ

Изначально документ попал в руки к SEO-эксперту Ренду Фишкину от анонимного источника. Позже друзья Ренда, экс-сотрудники Google, подтвердили, что документ настоящий и это не какой-то вброс горе-пиарщиков Google.

Что мы можем использовать на практике?

Всю информацию я разбил на блоки которые относятся к той или иной части SEO (продвижения сайтов в поиске) — контент, ссылки, поведение пользователей и т.д.

Траст сайт — существует, теперь официально.

Google использует параметр Авторитетности сайта, хотя во всех публичных выступлениях они утверждали обратное. Теперь бесполезно спорить есть траст или нет — теперь это факт.

На мой взгляд траст он является краеугольным успехом в SEO уже как минимум 3-4 года. Что интересно, в Google есть подвиды траста: общий, агрегированный траст сайта и отдельно траст, который рассчитывается ТОЛЬКО на основании поведения пользователей.

Как это использовать на практике:

Качайте бренд своего бизнеса (сайта) — это даст максимальный буст при продвижении: наращивайте брендовый трафик, привлекайте НЕпоисковый трафик, запускайте платную рекламу, чтобы показать что вы реальный бизнес, а не кто-то там с горы. Ссылки так же являются составляющей траст — особенно с авторитетных источников

Google активно использует поведенческие факторы в ранжировании

Да, из документации понятно, что Google собирает все данные с выдачи, а еще следит за всеми вашими действиями в Google Chrome, Google Maps, на YouTube и вообще во всех сервисах гугл. Все эти данные используются для сортировки сайтов в ТОП10 поисковой выдачи.

Важно отметить: ранее официальные лица Google заявляли, что не используют данные о поведении пользователей при ранжировании и даже высмеивали специалистов, которые утверждали обратное.

Какие поведенческие факторы четко ясны после прочтения документа:

- CTR вашего сайта в выдаче — если на сайт не кликают — это очень плохо. Google будет понижать позиции вашего сайта.

- Доля длинных кликов — это когда пользователь кликнул на ваш сайт и вовлекся в контент — т.е. остался на сайте на определенное время. Точное время в документе не указано — но для каждой тематики эти данные разнятся. Это еще раз подтверждает важность качества контента на сайте.

- Фактор отказа после посещения сайта: если пользователь перешел из поиска Google на ваш сайт и по какой-то причине сразу вернулся в поиск и открыл сайт конкурента — ваш сайт будет понижаться в ранжировании.

Из документации становится ясно, что не все клики с поиска одинаково влияют на ранжирование — какие-то больше, какие-то меньше.

- У Google есть специальный алгоритм защиты от накрутки поведенческих — все пользователи делятся на доверенных и недоверенных. Скорее всего здесь используется история Google-аккаунтов пользователей

- Есть отдельная защита от всплесков кликов и аномалий. Если происходит какой-то всплеск нетипичных для сайта кликов — он просто не учитывается.

- Именно поэтому накрутка поведенческих факторов в Google «не работает». Она работает — просто вам нужна орда живых людей, которые будут кликать по вашему сайту в поиске. При чем — людей из вашего региона. Клики из других регионов не учитываются.

Как это использовать на практике: нужно делать максимально релевантные Titlde и Description и немного разбавлять кликбейтом — чтобы выигрывать клики у конкурентов. Также ваш первый и второй экраны должны быть безупречными сразу давать вовлекать пользователя в контент, а не заставлять его уйти. Да, первые два экрана, а не SEO-текст с «нужным» количество ключевых слов

Именно поэтому сайты, которые массово генерируют контент с помощью ChatGPT и прочих нейронок, но не задумывают о его оформлении и ценности — УЖЕ были понижены в ранжировании (привет все пострадавшим от мартовского апдейта Google (2024))

Google сознательно занижает позиции молодых сайтов. Официально!

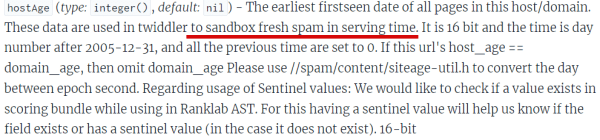

Да, у Google есть песочница для молодых сайтов — теперь это явно подтверждено В документе есть фактор HostAge и описании к нему явно написано — это возраст домена, который мы начинаем учитывать с момента первого посещения сайта роботом. В документе обозначена благая цель данного фактора — защитить Google от спама. Верим!

Как это использовать на практике: если вы делаете новый сайт или запускаете новый бизнес — сделайте сайт на Тильде или любом другом движке/конструкторе из 5-10 страниц и добавьте его в гугл — время будет работать на вас. Лучше правда сделать 5-10 страниц, а не одну страницу с текстом «Скоро тут будет наш сайт бла-бла-бла» — это может не сработать

Ссылки — все еще один из значимых факторов ранжирования

В документе довольно много ссылочных факторов — какие-то описывают то, как Google распознает спамные ссылки, какие-то показывают какие ссылки Google считает хорошими, а соотвественно, такие ссылки быстрее и лучше продвигают сайты в ТОП. До утечки факторов ранжирования Google, SEO-специалисты не могли и подозревать о некоторых нюансах учета ссылок.

Вот самое важное, что я нашел в документе:

- Ссылки все еще являются важным сигналом ранжирования и нет никаких факторов указывающих, что их влияние снижается. Ну то есть первый вывод — да продолжаем ставить ссылки — это работает

- Траст или качество ссылки во многом оценивается трастом главной страницы донора. То есть нет никакого смысла ставить много дешевых ссылок с мусорных сайтов

- Передаст ли ссылка вес или нет — во много может зависеть от кликовых и трафиковых показателей донора. Привет всем кто покупает дешевые ссылки в GoGetlinks с сайтов без трафика

В слитой документации много факторов про ссылочный анти-спам и вот самые интересные:

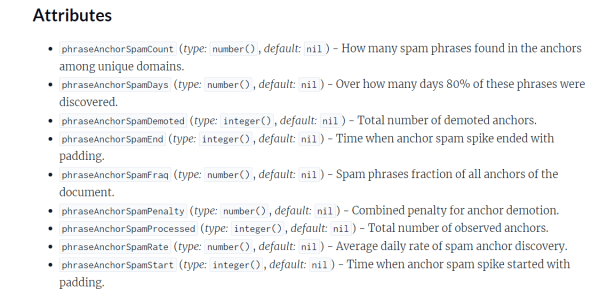

- Google разделяет анкоры на спамные и не спамные и у них есть соответствующий классификатор

- Гугл учитывает процент спамных анкоров во всем анкор листе сайта — то есть можно спамить, но аккуратно

- Google учитывает скорость прироста ссылок и есть отдельный фактор про ссылочный взрыв. Поставили много ссылок разом — получили штраф. Теперь официально

- Нашел интересный фактор, что для очень молодых сайтов есть специальный фактор который защищает новые сайты от пессимизации за большое количество ссылок. Иными словами — самые первые ссылки могут быть анкорными и это ОК. Наверное логика здесь такая, чтоб не пессимизировать сайты которые запускаются с поддержкой диджитал PR и сразу получают много ссылок

- Ссылки со СМИ заведомо считаются хорошими

- Для трастовых сайтов — спамные анкоры признаются не спамными — официально. Капитализм во всей красе — богатые богатеют и могут спамить как хотят

Как это использовать на практике: 1. Фокус только на ссылках с авторитетных ресурсов — лучше поставить 2 ссылки с авторитетных сайтов, чем 10-15 с каких-то мутных сайтов без трафика. Они могут вообще не работать 2. Ссылки со СМИ работают лучше. Можно спокойно ставить анкорные 3. Основная метрика оценки донора — его трафик и количество ссылок на главную

Метрики качества контента

В документе реально много упоминаний оценки качества сайта и контента. Особенно интересны следующие моменты.

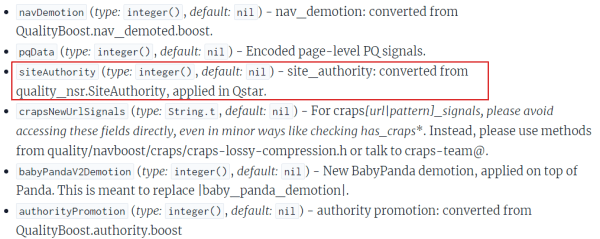

- Есть четкий параметр траста сайта — SiteAuthority — это авторитетность сайта в целом — на основе всех факторов

- Есть фактор, который отвечает за качество сайта на основе поведения пользователей. То есть тот же траст, но основанный только на поведении пользователей.

- Есть отдельная метрика, оценивает среднее качество всех статей на сайте. Я говорил в своих видео, что некачественный контент будет тянуть на дно качественны контент на вашем сайте

- Каждая страница оценивается еще и отдельно на основе метрик удовлетворенности пользователей

- Гугл отлично понимает кто автор статей на сайте, видит и пытается связать автора с компанией и всем его публикациями в интернете.

Отсюда можем сделать вывод — что траст сайта это многокомпонентный параметр и один из самых важных для SEO. И важно понимать, что траст рассчитывается не только на основе ссылок с Forbes или Википедии, а еще и на основе реального поведения пользователей. Про то как его прокачивать — смотрите у нас на YouTube-канале

Контент и все, что с ним связано

- Мета теги все еще очень важны — не забывайте про Title и Description

- Из документа понятно, что Google умеет определять темы и микро-подтемы в каждой статье. А с помощью NLP (технология распознавания живого человеческого языка) умеет определять на сколько ваша статья покрывает все микро-подтемы соответствующие запросу.

- Гугл умеет понимать — есть ли в вашей статье какая-то уникальная часть, ваша личная точка зрения или же это просто рерайт

- Гугл умеет определять когда страница обновлялась. И у него есть фактор «СУЩЕСТВЕННОЕ ИЗМЕНЕНИЕ КОНТЕНТА» — т.е когда вы пытаетесь читерить с датой обновления — большой брат все видит. Не прокатит

- В алгоритме немало факторов свежести, которые отвечают за качество контента

Если покопаться в документации — найдется еще с десяток интересных факторов, описывающих как Google оценивает контент сайтов.

Как это использовать на практике:1. Чтобы попасть в ТОП — нужно покрыть все микро-темы внутри статьи 2. Вы должны закрывать интент пользователя — т.е. решать ту задачу за которой он пришел или статья будет считаться неполезной и не будет занимать высокие позиции в ТОПе. Именно для этого гугл оценивает вовлеченность пользователя в контент 3. Нужно представить контент с какой-то уникальной точки зрения — раскрыть проблему так, как ее еще никто не раскрывал в ТОПе

Как и обещал в конце немного поговорим про теории заговора. Которые оказались весьма реальными

Первое, что стоит уяснить — не стоит доверять никаким официальным лицам компании Google — т.к. все их заявления делаются только в их интересах.

Практически все, что они писали у себя в официальных Твиттер аккаунтах оказалось враньем. То есть они специально вводили все маркетинг и SEO комьюнити в заблуждение.

Давайте пройдемся по фактам:

- Представители гугл заявляли, что не используют информацию о поведении пользователей в ранжировании. А оказалось, что активно используют и следят за своими пользователями с помощью Google Chrome

- Они заявляли что нет никакой песочницы на старте. А оказалось что есть — они специально занижают в ранжировании молодые сайты. И не важно с благими намерениями для защиты от спама или еще с какими — факт что их официальные лица врали в очередной раз

- Они говорили что понятия траста не существует. Оказывается существует да еще и несколько типов траста.

- Компания гугл уже несколько лет утверждает, что роль ссылочных сигналов снижается. Не снижается.

Так же судя по данным из утечки — Google имеет белые списки сайтов, которые искусственно повышает в ранжировании — например в сфере путешествий.

А есть и черные списки сайтов, которые никогда не попадут в ТОПы поиска — сайты с неугодным мнением про ковид и сайты сторонников одной из двух политических партий США, которых не устраивает текущая политика. Вот такая вот демократия 😀

Надо отметить, что в черных списках есть сайты, которые действительно не должны попадать в ТОПы выдачи — это сайты пе*офилов и прочей нечисти. Тут все верно, спору нет.

Это только часть того на чем поймали гугл в рамках исследования этого документа и в рамках недавнего судебного заседания. Почитать о других грехах корпорации можно в статье у Ренда Фишкина, который собственно и выложил этот документа в паблик.

Интересные разделы документации для изучения

- GoogleApi.ContentWarehouse.V1.Model.CompressedQualitySignals — здесь описываются факторы ссылочного анти-спама

- GoogleApi.ContentWarehouse.V1.Model.CompressedQualitySignals — здесь описываются факторы качества и доверия сайтов

- GoogleApi.ContentWarehouse.V1.Model.QualityNsrNsrData — здесь описыватся как Google классифицирует сайты и еще есть метрики качества

- Другие интересные факторы которые я нашел — можно посмотреть в этом посте у меня в Telegram

Где получать аналогичный контент от меня и команды Rush Agency?

- Наш YouTube-канал про поисковыq маркетнг и SEO

- Наш Telegram-канал про поисковый маркетинг и SEO

- Мой Telegram-канал про Digital-бизнес

Еще полезные ссылки по утечке факторов ранжирования Google

1. Оригинальный пост Ренда Фишкина

2. Отличный разбор факторов от Макла Кинга

3. Ссылка на саму слитую документацию

4. Удобный поисковик по документации

575 показов 98 открытий

Источник: vc.ru